Se sono serviti 80 anni al cinema per sviluppare tecniche volte a creare l’illusione e farci stupire con immagini incredibili, ne sono bastati solo 20 per sostituirle tutte con un unico mezzo: il computer.

È interessante però sapere che il computer sostituisce solo il modo di realizzare gli effetti ma non le tecniche, che rimangono praticamente identiche fino ad oggi, solo semplificate e velocizzate dal nuovo mezzo. Rimane infatti il blue screen, il compositing, il rotoscoping, il matte painting a cui si aggiunge la grafica tridimensionale.

È molto complicato cercare di sintetizzare tutti gli step che ci sono stati per arrivare al cinema come lo conosciamo oggi; cercherò quindi in questa sede di parlarvi di quelli che per me sono i film chiave per gli effetti visivi.

Fotogramma iniziale e finale della sequenza di apertura di “Star Trek II”, chiamato anche effetto genesi, realizzato dalla Pixar.

La nascita degli effetti visivi

Nei primi anni ’80, di pari passo con lo sviluppo dei videogame, alcuni temerari provarono a utilizzare queste rudimentali animazioni tridimensionali per inserirle nei film. Precursori di questa strada sono sicuramente la ILM, di George Lucas, e la Pixar, a quei tempi una divisione della ILM. Nel 1982, dopo piccoli inserimenti di grafica 3-D in wireframe, come in “Alien” di Ridley Scott del 1979 nei monitor dell’astronave Nostromo, la Pixar realizza un minuto di sequenza della genesi di un pianeta totalmente in computer grafica. Vista oggi, abituati al fotorealismo assoluto, la sequenza di apertura di “Star Trek II: The Wrath of Khan” può sembrare grossolana, ma in realtà anche con i limiti dei computer di quel tempo la Pixar era riuscita a creare un movimento di camera ed un effetto di trasformazione fino ad allora impossibile da realizzare.

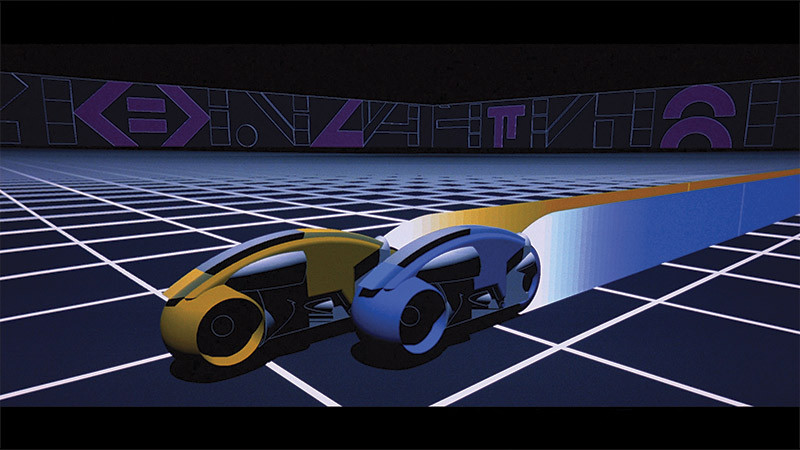

È però “Tron” nel 1982, film ispirato al mondo dei videogiochi, ad essere considerato il precursore degli effetti visivi. “Tron” di Steven Lisberger, prodotto dalla Disney, è il primo film d’azione ad usare la computer grafica per un totale di 20 minuti di sequenze. La pellicola, a mio avviso, è bellissima e spettacolare proprio per l’uso degli effetti in funzione della storia, eppure fu esclusa dagli Oscar in quanto la giuria riteneva che il lavoro degli animatori era stato avvantaggiato in modo scorretto dall’uso del computer, mentre nella realtà era stato molto lungo e complicato.

Serviranno ben 7 anni per rendersi conto che era nato un nuovo settore cinematografico ed assegnare un Oscar per gli effetti speciali a “The Abyss” (1989) di Cameron, realizzato con le stesse tecniche di “Tron”. Anche se nel frattempo ci furono numerosi esempi di computer grafica, in “The Abyss” ancora la ILM creò il primo personaggio virtuale: un tentacolo acquatico che prende anche forma di un volto umano con effetto morphing. La sequenza dura poco più di un minuto ma la ILM impiegò più di sei mesi per realizzarla.

Lo sviluppo del nuovo mezzo

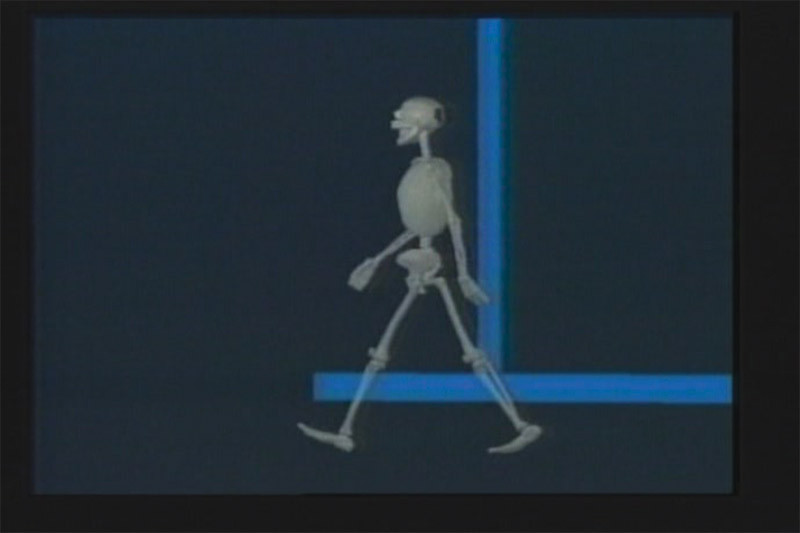

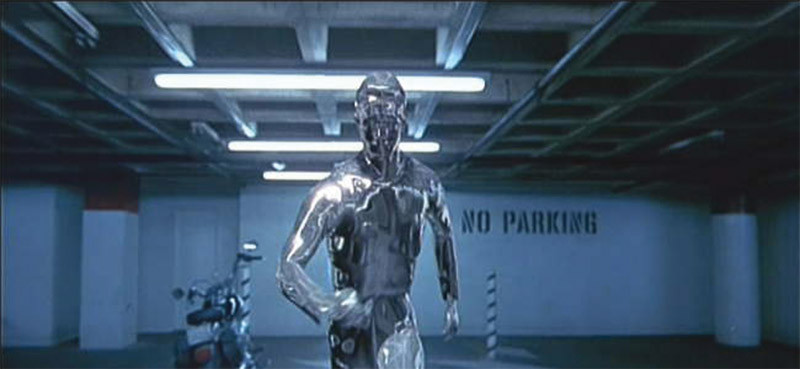

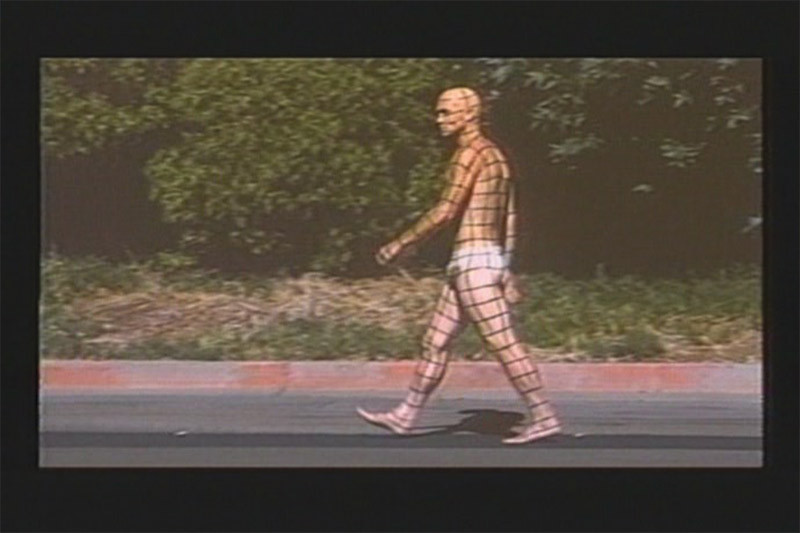

Cameron ci prese gusto e solo 3 anni dopo conquistò un altro Oscar per gli effetti visivi con “Terminator 2”. Il secondo capitolo della saga è sicuramente un punto di svolta nella storia degli effetti speciali. Il Terminator T-1000 viene inserito nella scrittura del film solo perché in quegli anni il computer era in grado di proiettare delle mappe di riflessione su oggetti tridimensionali e siccome l’effetto creava oggetti metallici molto realistici si pensò di costruire una storia intorno ad esso. I modelli 3-D creati vennero animati con molta pazienza. Tutti i movimenti furono creati fotogramma per fotogramma da sequenze di riferimento dell’attore Robert Patrick che correva in mutande pennellato come un foglio a quadretti.

L’effetto morphing (trasformazione di un elemento in un altro), sempre generato al computer, venne perfezionato con questo film ed è così che nasce anche la sequenza finale del video di Michael Jackson “Black or White” che ancora oggi lascia senza parole. Considero “Terminator 2” un punto di svolta perché per la prima volta all’effetto speciale viene data tanta importanza da farlo diventare il protagonista del film, e questa sfida vinta da Cameron apre gli occhi sul potenziale del computer, fino ad allora non considerato per la sua scarsa qualità rispetto a quella richiesta per il cinema. La strada era stata aperta e gli anni a seguire sono un periodo di transizione che vedono fiorire tantissimi film che fanno uso di effetti visivi.

Filmato di riferimento servito per ricreare l’animazione tridimensionale dell’attore Robert Patrick in “Terminator 2”, un metodo oggi sostituito in automatico con la tecnica del motion capture come in “Avatar”.

a palla la raccoglie Robert Zemeckis che sforna tra il 1992 e il 1997 tre bellissimi film: “La morte ti fa bella”, “Forrest Gump” e “Contact”. Zemeckis è tra i primi ad utilizzare gli effetti in funzione della storia e non il contrario; intuisce che può usare il nuovo mezzo senza impressionare lo spettatore e nasconde gli effetti (effetti non percettibili). Soprattutto in “Forrest Gump” e “Contact” ci sono movimenti di camera e sequenze che agli occhi degli spettatori sembrano senza effetti; in pratica, utilizza il computer per emozionare e non per stupire.

Il punto di arrivo degli effetti visivi

A far ricredere anche i più scettici che ormai il computer era diventato parte fondamentale nella costruzione di un qualsiasi film basta citare “Toy Story” della Pixar del 1995 (il primo film totalmente realizzato al computer), “Star Wars Episodio I” del 1999 (con oltre il 90% delle riprese con inserimenti di effetti speciali) e, secondo me, il punto di arrivo della nostra analisi, “Final Fantasy: The Spirits Within” del 2001 di Hironobu Sakaguchi e Moto Sakakibara (film fotorealistico totalmente in computer grafica).

“Final Fantasy” non è un bel film ed inoltre è stato un flop finanziario che ha costretto alla bancarotta la società di produzione Square Pictures, ma un merito deve essergli riconosciuto: ha dimostrato che con la computer grafica ed il compositing digitale ormai era possibile realizzare tutto. Allo stesso tempo, dimostra che l’effetto speciale non è nulla senza contenuto. Dal 2001 gli effetti visivi migliorano continuamente in realismo e questo grazie non a scoperte particolari, ma semplicemente all’aumento esponenziale della potenza di calcolo dei computer. Il passaggio in digitale oggi è completo e qualsiasi produzione anche se girata in pellicola (a dire il vero sempre meno) viene convertita interamente sia per il montaggio che per gli effetti per poi essere riversata nuovamente, se necessario, in pellicola. Le tecniche per creare gli effetti, come detto in precedenza, non sono mutate più di molto, addirittura sono molto simili a quelle usate dal lontano Méliès, solo che adesso si lavora molto più comodi seduti ad una scrivania con un mouse o una penna grafica.

I software per gli effetti speciali

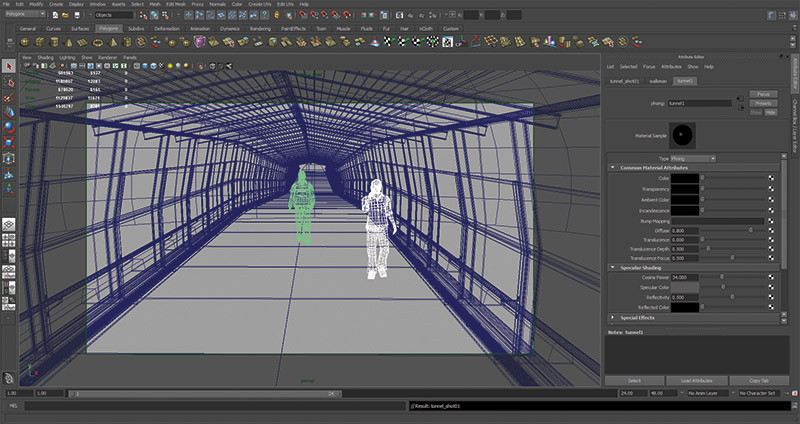

I software usati per creare gli effetti speciali sono oggi tantissimi, ma si possono suddividere in due grandi categorie: software di modellazione, animazione e renderizzazione tridimensionale e software di compositing. I primi vengono usati per creare ed animare immagini tridimensionali totalmente digitali. Il livello raggiunto da questi programmi permette ormai di realizzare qualsiasi ambiente, cosa, animale o persona con un altissimo dettaglio. Naturalmente il computer non fa niente da solo ed il lavoro che c’è dietro la creazione e l’animazione di un ambiente virtuale o ancora di un personaggio digitale continua ad essere molto lungo e di competenza di professionisti; il fattore umano è imprescindibile. Il computer sicuramente aiuta, ma la parte della creazione e animazione di un personaggio risulta ancora oggi la più lunga di tutto il processo. Nonostante l’aumento della potenza di calcolo dei computer, i tempi di rendering (elaborazione dell’immagine tramite il calcolo del computer) sono ancora molto lunghi e questo perché, di pari passo con l’aumento della potenza a disposizione, sono cresciute le esigenze di realizzare immagini sempre maggiori di risoluzione e con più realismo. Capostipite di questi software è sicuramente Maya nato nel 1998 dalla Alias (adesso della Autodesk) usato sin dall’inizio soprattutto per la capacità di implementazione di procedure scritte direttamente dall’utente. I programmatori delle case di produzione hanno così potuto aumentarne le potenzialità negli anni. Ancora oggi risulta essere il più utilizzato negli effetti visivi anche se ormai è un software vecchio, molto difficile da usare e poco stabile.

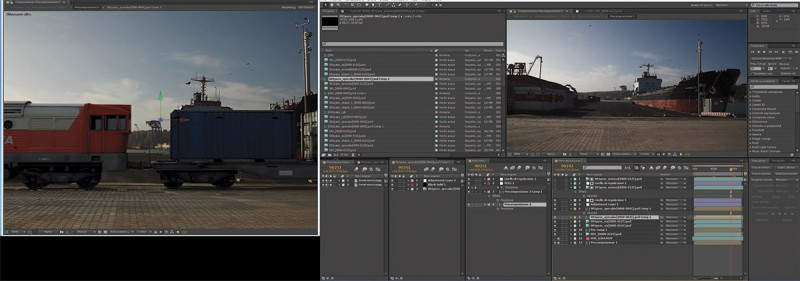

Altri software del genere sono 3D Studio Max, Modo, Cinema 4D, Softimage e molti altri. Questi software hanno sostituito il lavoro che faceva Harryhausen con i suoi modellini animati a passo uno o la creazione di matte painting una volta dipinti ed adesso completamente creati in digitale. I software di compositing, invece, sostituiscono totalmente la fotocomposizione ottica. Permettono di comporre tra loro i vari elementi reali e virtuali in un singolo quadro.

Fanno parte di questa categoria IFF software (Inferno, Flame e Flint) della Autodesk Media and Entertainment, programmi dal costo di centinaia di migliaia di euro venduti solitamente insieme all’hardware, capaci di creare effetti in tempo reale (tempi di rendering quasi immediati). Queste suite sono a disposizione di grosse produzioni, visto il costo molto alto anche degli operatori per farle funzionare. La potenza dei computer desktop degli ultimi anni ha però consentito l’utilizzo di computer dal costo più contenuto, anche per film di grosse produzioni.

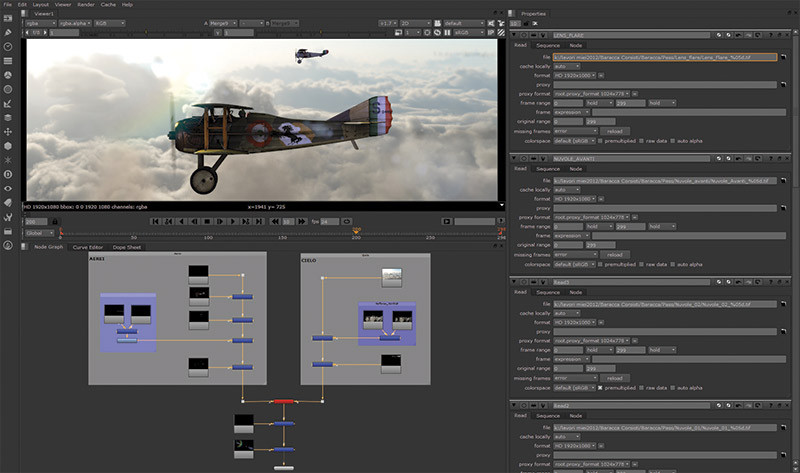

Sono nati così software di compositing molto più accessibili come After Effects, Nuke e Fusion, per citare i più importanti. After Effects della Adobe è sicuramente il più semplice da usare anche se nasce non proprio come software di compositing ma di motion graphics (grafica in movimento) e risulta essere molto difficile da gestire in progetti complessi, vista la sua struttura a livelli come Photoshop. Vera rivoluzione per i sistemi desktop è invece Nuke, della The Foundry.

Nuke sfrutta lo stesso metodo di compositing usato nella suite della Autodesk Media and Entertainment, cioè la gestione a nodi invece che quella a livelli usata in After Effects. Il sistema sicuramente è meno intuitivo ma più professionale, permettendo una visualizzazione rapida di tutto il processo di composizione. Sono stati realizzati con Nuke film tipo “Avatar”, “Tron: Legacy”, “Alice nel paese delle meraviglie”, solo per citarne alcuni.

Termina qui la nostra breve analisi della storia degli effetti speciali. Nei prossimi articoli cercheremo di approfondire la conoscenza di questi software, per sviluppare piccoli effetti speciali con i normali computer a nostra disposizione.

di Ermanno Di Nicola

da Digital Video n. 152 aprile-maggio 2013